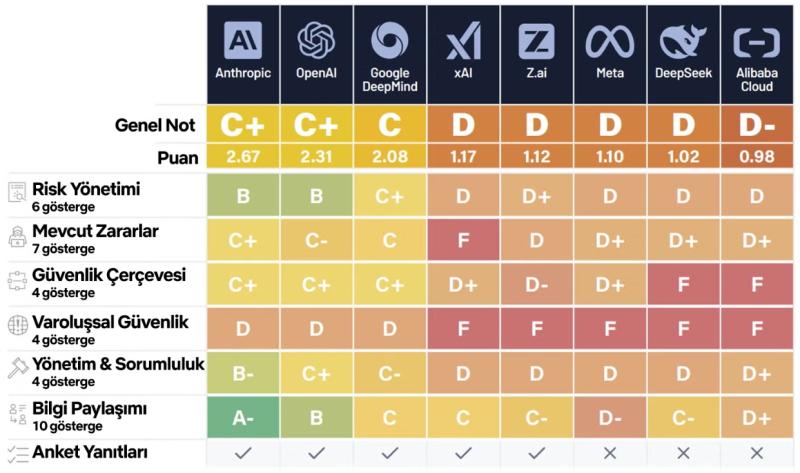

Future of Life Institute tarafından yapılan yeni bir değerlendirme, önde gelen yapay zeka şirketlerinin büyük bölümünün gelişmiş sistemlerin gerektirdiği güvenlik, bağımsız denetim ve uzun vadeli risk yönetimi konularında ciddi eksiklikler taşıdığını ortaya koydu. Kuruluşun hazırladığı Yapay Zeka Güvenlik Endeksi’ne göre, incelenen 8 büyük şirketin hiçbiri varoluşsal risk kategorisinde “D” seviyesinin üzerine çıkamadı.

Endekste en yüksek puanları ABD merkezli şirketler alırken, zirvede Anthropic yer aldı; OpenAI ve Google DeepMind ise onun ardından geldi. Çin merkezli şirketlerin performansı genel olarak düşük kaldı ve Alibaba Cloud, DeepSeek’in hemen gerisinde sıralandı. Varoluşsal risk değerlendirmesinde Alibaba Cloud, DeepSeek, Meta, xAI ve Z.ai, en düşük seviye olan “F” notuyla değerlendirildi.

“DAHA ETKİLİ ÖNLEMLER ALINSIN” ÇAĞRISI

Independent Türkçe'de yer alan habere göre, raporda, sektörün genel olarak hızla güçlenen yapay genel zeka ve süper zeka hedeflerine odaklanırken, bu sistemlerin kontrol kaybı veya kötüye kullanım gibi potansiyel felaket senaryolarına karşı güvenilir bir strateji sunamadığı vurgulandı. Araştırmacılar, şirketleri güvenlik süreçleri konusunda daha şeffaf olmaya ve kullanıcıları daha acil zarar türlerinden (örneğin yapay zeka psikozu) korumak için daha etkili önlemler almaya çağırdı.

UC Berkeley profesörü Stuart Russell, şirketlerin insanüstü yapay zeka geliştirme konusunda iddialı olduklarını ancak bu sistemlerin kontrolden çıkmasını nasıl engelleyeceklerine dair ikna edici bir plan sunamadıklarını belirterek, “Bu durumda insanlığın geleceğini garanti altına almak bizim elimizde değil” dedi. Russell, nükleer reaktör güvenlik seviyesine eşdeğer bir kontrol kaybı riski beklediğini ancak şirketlerin çok daha yüksek oranları kabul ettiğini ifade etti.

OpenAI ve Google, güvenlik protokollerini geliştirmek için bağımsız uzmanlarla çalıştıklarını ve risk azaltma süreçlerini güçlendirdiklerini belirtirken; diğer şirketlerden yorum alınamadı.