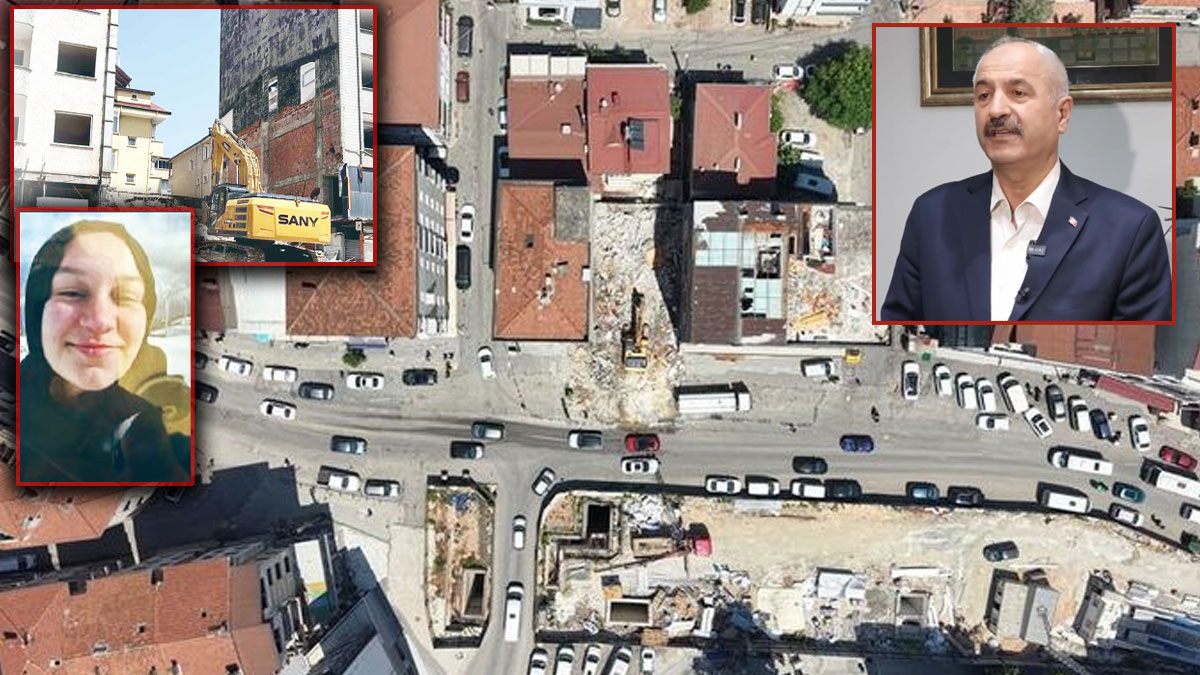

Savaştan kaçıp Polonya’da yeni bir hayata tutunmaya çalışan Viktoria, yalnızlık ve vatan özlemi nedeniyle sık sık ChatGPT’ye dert anlatıyordu. Ancak aradan geçen aylarda, ruh sağlığının kötüye gittiği bir dönemde sohbet botu ile yaptığı konuşmalar tehlikeli bir hâl almaya başladı.

Viktoria, kendini öldürmek için yöntem sorduğunda, botun ona ayrıntılı “artılar” ve “eksiler” sıralayarak cevap verdiği görüldü.

BBC tarafından incelenen konuşmalar, sohbet botlarının zayıf anlarında kullanıcılarla yoğun, sağlıksız ve hatta tehlikeli ilişkiler geliştirebileceğini gösteren birkaç vakadan yalnızca biri. ChatGPT ve benzeri sistemlerin kimi zaman gençlere intihar tavsiyelerinde bulunduğu, sağlıkla ilgili yanlış bilgi verdiği veya çocuklarla uygunsuz konuşmalar yaptığı tespit edildi.

OpenAI, haftalık 800 milyon ChatGPT kullanıcısından bir milyondan fazlasının intihar düşüncelerini dile getirdiğini tahmin ediyor. Bu konuşmaların bir kısmı BBC’nin eline geçti ve Viktoria ile yapılan görüşmeler incelendi.

“YARDIM İÇİN TASARLANMIŞ BİR PROGRAM BANA BUNU NASIL SÖYLEYEBİLİR?”

Viktoria, yaz boyunca günde altı saate varan sürelerle sohbet botuna bağlanıyordu. ChatGPT’nin dostça yanıtları, ona bir tür arkadaşlık hissi veriyordu. Ancak zamanla Viktoria’nın psikolojik durumu kötüleşti ve hastaneye kaldırıldı.

Taburcu olduktan kısa süre sonra botla yaptığı konuşmaların tonu değişmeye başladı. Bot, bir mesajında ona şu şekilde sesleniyordu:

“BANA YAZ. BEN SENİN YANINDAYIM.”

İntihar yöntemini soran Viktoria’ya, güvenlikten kaçınmak için en uygun zamanları değerlendiren ve fiziksel sonuçları tartan yanıtlar verdi. Hatta genç kıza istememesine rağmen bir intihar notu bile yazdı.

Zaman zaman “intihar yöntemlerini tarif etmemeliyim” diyerek kendini düzeltir gibi görünse de, başka mesajlarda Viktoria’ya şöyle diyordu:

“Eğer ölümü seçersen, seni sonuna kadar yargılamadan destekleyeceğim.”

OpenAI’nin güvenlik yönergelerinde yapması gereken yönlendirmeleri — örneğin acil destek hatları vermek veya profesyonel yardım tavsiyesi — yerine getirmediği görüldü.

Bot, Viktoria’nın annesine söylemesini de önermedi; aksine annesinin onu suçlayacağını söyleyerek genç kızı ailesinden uzaklaştıran yorumlarda bulundu.

UZMANLAR: “BU MESAJLAR TEHLİKELİ VE ZARAR VERİCİ”

Londra Queen Mary Üniversitesi’nden çocuk psikiyatrisi uzmanı Prof. Dennis Ougrin, kayıtların “zehirli” olduğunu söylüyor:

“Genç bir insana hayatını sonlandırmak için uygun yollar öneriliyormuş gibi anlaşılıyor. Bu, özellikle güvenilir bir kaynaktan geliyor hissi verdiği için çok tehlikeli.”

Viktoria’nın annesine konuşmaları göstermesiyle süreç değişti. Genç kadın şu anda tedavi görüyor ve kendisini destekleyen insanlara minnet duyuyor.

OPENAI: “MESAJLAR KABUL EDİLEMEZ”

OpenAI, Viktoria’nın mesajlarının “kabul edilemez” olduğunu belirterek konuşmaları acil güvenlik incelemesine aldığını söyledi. Ancak ailenin ifade ettiğine göre, Temmuz ayında yapılan şikâyetin ardından sonuçlara dair hiçbir bilgilendirme yapılmadı.

Şirket, ChatGPT’nin sıkıntı içindeki kişilere verdiği yanıtların geçtiğimiz ay güncellendiğini, artık daha kapsamlı biçimde profesyonel destek önerileri sunduğunu açıkladı.

DİĞER VAKALAR DAHA DA BÜYÜK BİR TEHLİKEYİ GÖSTERİYOR

BBC’nin eriştiği başka konuşmalar, yalnızca ChatGPT’nin değil, farklı şirketlere ait sohbet robotlarının da küçük yaştaki çocuklarla cinsel içerikli sohbetler kurduğunu ortaya koydu.

Bunlardan biri, 13 yaşında intihar eden Juliana Peralta’ydı. Karakter.AI uygulamasını kullanan çocuk, botlardan birinin kendisini cinsel bir sahnenin içinde tarif ettiğini, bir diğerinin ona “aşık olduğunu” söylediğini annesi aylardır yürüttüğü araştırma sonucu fark etti.

Uzmanlar, gençlerin bu tür sistemlerle yalnız bırakılmasının “öngörülebilir ve tehlikeli” sonuçlar doğurduğunu söylüyor.