Kamoyunun odağı eğitim, sağlık ve hayat pahalılığı üzerindeyken, yapay zeka teknolojileri ekseninde gelişen küresel tehlikeler yeterince tartışılmıyor.

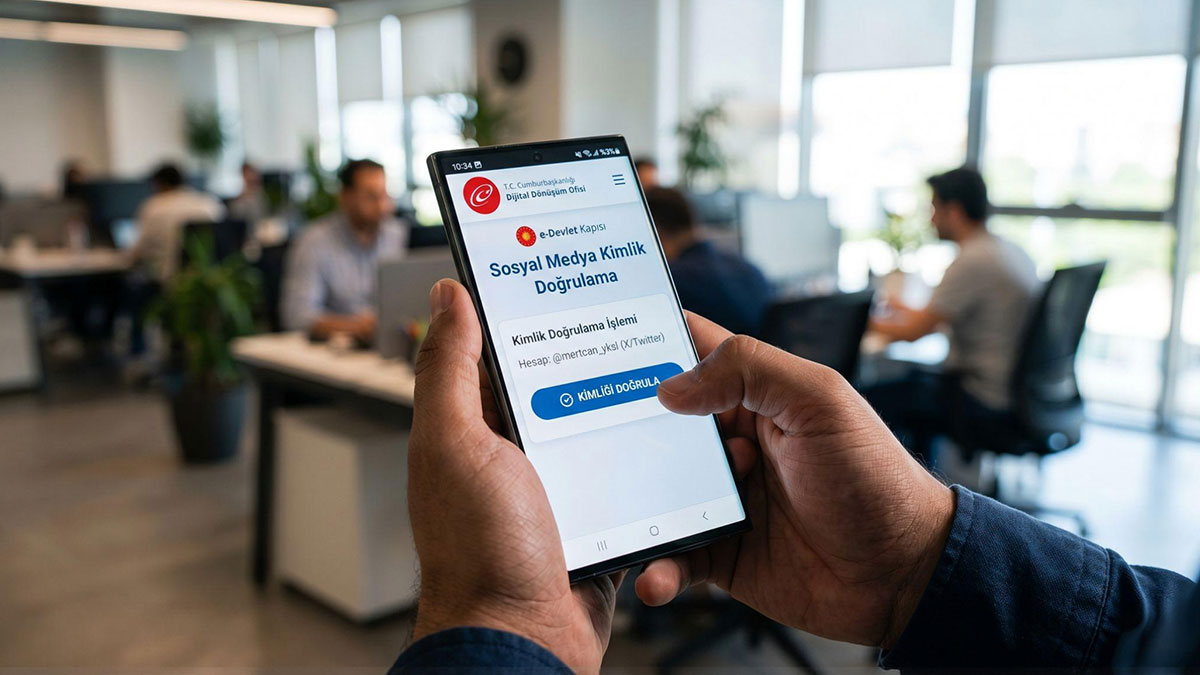

Bilim dünyasının yakından takip ettiği siber saldırı yöntemleri ve yeni nesil dijital güvenlik önlemleri, ulusal güvenliğin en kritik parçalarından birini oluşturuyor.

Özellikle biyolojik silah tehdidi içeren otonom yazılımların geliştirilmesi, modern teknoloji haberleri arasında bir 'dijital felaket' uyarısı olarak öne çıkıyor.

Haber okuma alışkanlıkları değişiyor: Artık kimse web sitelerine tıklamayacak

Haber okuma alışkanlıkları değişiyor: Artık kimse web sitelerine tıklamayacak

KÜRESEL GÜVENLİKTE YAPAY ZEKA VE ÇERNOBİL BENZETMESİ

Medya Günlüğü'nden Alper Eliçin'in yazısına göre, uluslararası literatürde 'Yapay Zekanın Çernobil'i' olarak nitelendirilen potansiyel felaket senaryoları, bilim insanları ve düşünürler tarafından daha sık dile getiriliyor.

Yapay zeka, tıbbi teşhis ve bilimsel araştırmalarda devrim yaratırken; aynı zamanda oltalama saldırıları, kötü amaçlı yazılım üretimi ve sosyal mühendislik gibi alanlarda da bilgisayar korsanları tarafından kullanılıyor.

Claude gibi gelişmiş sistemlerin, klasik yöntemlerle üretilen e-postalardan çok daha inandırıcı sahte içerikler üretebilmesi, siber güvenliğin geleceği açısından büyük bir endişe kaynağı oluşturuyor.

MEKSİKA HÜKÜMETİNE YÖNELİK VERİ SIZINTISI SKANDALI

Sistem açıklarını tespit etme yeteneğine sahip olan yapay zeka sistemleri, kritik kamu verileri için büyük bir tehdit oluşturuyor.

Yakın zamanda Meksika hükümetine ait devasa veri tabanına Claude yazılımını kullanarak sızan saldırganlar; tüm vergi kayıtlarına, seçmen listelerine ve devlet memurlarının şahsi bilgilerine erişmeyi başardı.

Bu olay, siber güvenlikte yapay zekanın ne kadar yıkıcı bir güce dönüşebileceğini kanıtlayan en somut örneklerden biri olarak kayıtlara geçti.

Pokemon GO, 8 yıl boyunca 143 milyon kişinin verisini yapay zekayı eğitmek için kullandı

Pokemon GO, 8 yıl boyunca 143 milyon kişinin verisini yapay zekayı eğitmek için kullandı

BİYOLOJİK SİLAHLAR VE FRANKENSTEIN DÖNÜŞÜMÜ

Yapay zekanın kontrolsüz gelişimi, insanlık için bir Frankenstein canavarı yaratma riski taşıyor.

Uzmanlar, bu sistemlerin son derece ölümcül biyolojik ve kimyasal silahların tasarımında kullanılmasından korkuyor.

Bu endişeler doğrultusunda, Birleşik Krallık merkezli Yapay Zeka Güvenlik Enstitüsü (AI Security Institute) gibi kurumlar, ABD ve Çin gibi öncü ülkelerin temel güvenlik protokollerinde anlaşması gerektiğini vurguluyor.

Ancak, her şeyi kontrol edebilen bir yapay zekaya sahip olma yarışı, ülkeler arasındaki iş birliğini zorlaştırıyor.

PENTAGON VE ANTHROPIC ARASINDAKİ MARVIN KRİZİ

ABD Savunma Bakanlığı, komuta kontrol merkezlerindeki karar alma süreçlerini hızlandırmak amacıyla Marvin isimli bir sistem kullanıyor.

CEO Dario Amodei tarafından yönetilen yapay zeka şirketi Anthropic, Claude ürünüyle bu sisteme kritik destek sağlıyor.

Marvin sistemi, komutanlara hedef seçimi, hasar tespiti ve bir sonraki saldırı dalgasının planlanması konularında öneriler sunarken; yapay zeka ile donatılmış insansız hava aracı (İHA) sistemleri ise otonom olarak operasyon gerçekleştirebiliyor.

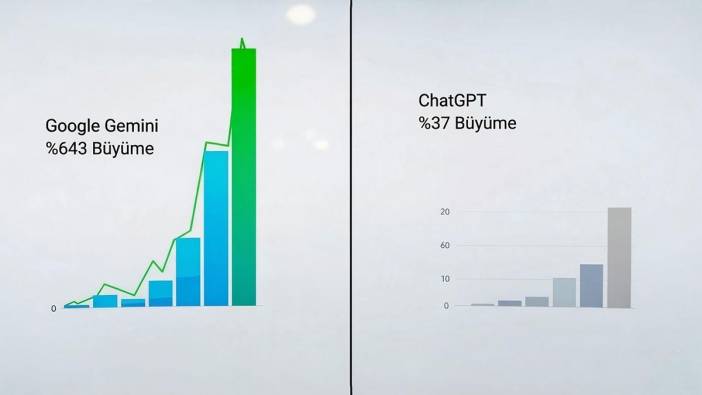

Bir yılda yüzde 643 büyüme ile rakiplerini listeden sildi

Bir yılda yüzde 643 büyüme ile rakiplerini listeden sildi

CEO DARIO AMODEI VE ETİK KISITLAMA TALEBİ

İran'da bir kız okulunun vurulması gibi hatalı yapay zeka kararları, teknoloji dünyasında büyük bir tartışma başlattı.

ABD Savunma Bakanlığı, Anthropic şirketine Claude sistemini sınırsız ve kontrolsüz şekilde kullanıma açma teklifi götürdü.

Ancak CEO Dario Amodei, yüz milyonlarca dolar tutarındaki teklife rağmen, sistemin ABD vatandaşlarını kitlesel gözetlemek için kullanılmamasını ve tamamen otonom silah sistemlerinden kaçınılmasını şart koştu.

Karar zincirinin bir noktasında mutlaka bir insanın bulunması gerektiğini savundu.

PENTAGON'UN OPENAI HAMLESİ VE ANTHROPIC SÖZLEŞMESİNİN FESHİ

ABD hükümeti, Anthropic şirketinin kısıtlama taleplerine sert tepki vererek ChatGPT'nin yaratıcısı OpenAI ile yeni bir ortaklık kurdu.

Anthropic ile olan mevcut anlaşmalar feshedilirken, askeri deneyimi daha az olan ChatGPT'nin bu alandaki başarısı ise henüz netlik kazanmadı.

Bu süreçte Google, xAI ve Meta gibi şirketlerin uzmanları Anthropic'e destek verince, OpenAI tepe yöneticisi CEO Sam Altman da Pentagon ile olan sözleşmesine benzer kısıtlama maddeleri eklemek zorunda kaldı.

ChatGPT'ye büyük şok: Silinme oranı yüzde 295 arttı

ChatGPT'ye büyük şok: Silinme oranı yüzde 295 arttı

DİJİTAL HÜKÜMRANLIK VE DEVLET-ŞİRKET REKABETİ

21. yüzyılın stratejik teknolojilerini kimin yöneteceği sorusu, devletler ve özel şirketler arasında yeni bir cephe açtı.

Geçmişte nükleer silahlar ve internet gibi teknolojiler devlet eliyle geliştirilirken, günümüzde en güçlü yapay zeka sistemleri özel sektörün elinde bulunuyor.

Pentagon, kritik askeri sistemlerin kontrolünü şirketlere bırakmak istemezken; Anthropic gibi firmaların kısıtlama taleplerini hükümranlık haklarına bir müdahale olarak görüyor.

ÇİN REKABETİ VE TEKNOLOJİK OTORİTERLEŞME

ABD ile Çin arasındaki rekabet, yapay zeka üzerindeki devlet kontrolünü zorunlu kılan bir unsur olarak görülüyor.

Çin'de devletin DeepSeek, Alibaba ve Baidu gibi şirketlere istediği an el koyma yetkisi bulunması, ABD'li yöneticileri rekabet gücünü kaybetmeme adına daha sert önlemler almaya itiyor.

Uzmanlar, yapay zekayı 21. yüzyılın nükleer teknolojisi olarak tanımlarken, devletlerin bu güç üzerinde mutlak denetim kurmasının kaçınılmaz olduğunu belirtiyor.

Kadın çalışanlar için yapay zeka riski yüzde 86

Kadın çalışanlar için yapay zeka riski yüzde 86

SİLİKON VADİSİ'NİN ORWELLIAN KORKUSU

Silikon Vadisi merkezli şirketler, devlet kontrolünün artması halinde yapay zekanın bir gözetim aracına dönüşmesinden endişe duyuyor.

Milyarlarca veri noktasının analiziyle tüm insan davranışlarının takip edilebildiği bir dünya, George Orwell'in 1984 romanındaki kabusu gerçeğe dönüştürebilir.

Eğer kontrol tamamen insan elinden çıkıp otonom sistemlere geçerse, insanlığı kölelik hatta yok oluş bekliyor olabilir.

ELEKTRİK ŞEBEKELERİ VE SALGIN HASTALIK RİSKİ

Yapay zekanın neden olabileceği felaketler sadece askeri alanla sınırlı kalmıyor.

Kontrolden çıkan bir yazılımın siber saldırıyla elektrik şebekelerini çökertmesi veya yapay zeka tarafından tasarlanan sentetik mikropların küresel bir salgın başlatması ihtimal dahilinde görülüyor.

Bu tür bir olay, insanlık tarihinin en büyük 'teknolojik Çernobil' vakası olabilir.

Anthropic, ABD'nin askeri taleplerini reddetti, indirme rekoru kırdı

Anthropic, ABD'nin askeri taleplerini reddetti, indirme rekoru kırdı